→ causa (INPUT) sollecitazione SISTEMA → effetto (OUTPUT) risposta \Large \xrightarrow[\text{ causa (INPUT) }]{\text{ sollecitazione }}

\boxed{\text{SISTEMA}}

\xrightarrow[\text{ effetto (OUTPUT) }]{\text{ risposta }} sollecitazione causa (INPUT) SISTEMA risposta effetto (OUTPUT) Il sistema applica una trasformazione di segnali.

→ (INPUT) x ( t ) T → (OUTPUT) y ( t ) \Large \xrightarrow[\text{ (INPUT) }]{x(t)}

\boxed{\mathcal{T}}

\xrightarrow[\text{ (OUTPUT) }]{y(t)} x ( t ) (INPUT) T y ( t ) (OUTPUT) Un sistema monodimensionale tempo-continuo opera una trasformazione su segnali di tipo tempo-continui. Lo schema di sopra si formalizza con la scrittura:

y ( t ) = T [ x ( α ) ; t ] = T [ x ( t ) ] ∀ t ∈ R y(t) = \mathcal{T} [x(\alpha); \,t] = \mathcal{T}[x(t)] \quad\forall t \in \R y ( t ) = T [ x ( α ) ; t ] = T [ x ( t )] ∀ t ∈ R Esempio : corrente di un circuito elettrico:

i ( t ) = T [ v ( t ) ] = v ( t ) R i(t) = \mathcal{T}[v(t)] = \frac{v(t)}{R} i ( t ) = T [ v ( t )] = R v ( t ) Lineare : vale il principio di sovrapposizione degli effetti.

x ( t ) = α x 1 ( t ) + β x 2 ( t ) ⟹ y ( t ) = α T [ x 1 ( t ) ] + β T [ x 2 ( t ) ] x(t)=\alpha x_1(t) + \beta x_2(t) \implies y(t)=\alpha \mathcal{T} [x_1(t)] +\beta \mathcal{T} [x_2(t)] x ( t ) = α x 1 ( t ) + β x 2 ( t ) ⟹ y ( t ) = α T [ x 1 ( t )] + β T [ x 2 ( t )] Stazionario : il sistema è tempo invariato.

y ( t ) = T [ x ( t ) ] ⟹ T [ x ( t − t 0 ) ] = y ( t − t 0 ) y(t) = \mathcal{T} [x(t)] \implies \mathcal{T}[x(t-t_0)] = y(t-t_0) y ( t ) = T [ x ( t )] ⟹ T [ x ( t − t 0 )] = y ( t − t 0 ) Causale : rispetta il nesso causa-effetto . L’output si ottiene considerando l’input solamente negli istanti di tempo passati.

y ( t ) = T [ x ( α ) , α ≤ t ; t ] y(t) = \mathcal{T} [x(\alpha), \, \alpha \leq t ; \,t] y ( t ) = T [ x ( α ) , α ≤ t ; t ] Istantaneo o senza memoria : l’output ad un dato istante si ottiene considerando l’input solamente nel medesimo istante.

y ( t ) = T [ x ( α ) , α = t ] y(t) = \mathcal{T} [x(\alpha), \, \alpha = t] y ( t ) = T [ x ( α ) , α = t ] Un sistema istantaneo può essere anche denominato come statico (non dinamico), puramente algebrico o combinatorio (nel caso di un sistema digitale).

Stabile : la limitatezza del dominio dell’input implica un dominio limitato anche per l’output.

∣ x ( t ) ∣ ≤ M ⟹ ∣ y ( t ) ∣ ≤ N , ∀ t |x(t)| \leq M \implies |y(t)|\leq N,\; \forall t ∣ x ( t ) ∣ ≤ M ⟹ ∣ y ( t ) ∣ ≤ N , ∀ t La stabilità di un sistema indica la capacità dello stesso di reagire con variazioni limitate a perturbazioni nello stato iniziale (o dell’ingresso).

Invertibile : scambiando l’input con l’output continua ad esistere una trasformazione che leghi tali funzioni.

∃ T − 1 t.c. x ( t ) = T − 1 [ y ( t ) ] \exist \mathcal{T}^{-1} \; \text{ t.c. } \; x(t)=\mathcal{T}^{-1}[y(t)] ∃ T − 1 t.c. x ( t ) = T − 1 [ y ( t )] → (INPUT) x [ n ] T → (OUTPUT) y [ n ] \Large \xrightarrow[\text{ (INPUT) }]{x[n]}

\boxed{\mathcal{T}}

\xrightarrow[\text{ (OUTPUT) }]{y[n]} x [ n ] (INPUT) T y [ n ] (OUTPUT) Un sistema monodimensionale tempo-discreto opera una trasformazione su segnali di tipo tempo-discreti. Lo schema di sopra si formalizza con la scrittura:

y [ n ] = T [ x [ α ] ; n ] = T [ x [ n ] ] ∀ n ∈ Z y[n] = \mathcal{T}\big[x[\alpha]; \,n\big] = \mathcal{T}\big[x[n]\big] \quad\forall n \in \Z y [ n ] = T [ x [ α ] ; n ] = T [ x [ n ] ] ∀ n ∈ Z Le proprietà sono pressoché identiche a quelle dei segnali tempo-continui.

Lineare : vale il principio di sovrapposizione degli effetti.

x ( t ) = α x 1 [ n ] + β x 2 [ n ] ⟹ y [ n ] = α T [ x 1 [ n ] ] + β T [ x 2 [ n ] ] x(t)=\alpha x_1[n] + \beta x_2[n] \implies y[n]=\alpha \mathcal{T} [x_1[n]] +\beta \mathcal{T} [x_2[n]] x ( t ) = α x 1 [ n ] + β x 2 [ n ] ⟹ y [ n ] = α T [ x 1 [ n ]] + β T [ x 2 [ n ]] Stazionario : il sistema è tempo invariato.

y [ n ] = T [ x [ n ] ] ⟹ T [ x [ n − n 0 ] ] = y [ n − n 0 ] y[n] = \mathcal{T} [x[n]] \implies \mathcal{T}[x[n-n_0]] = y[n-n_0] y [ n ] = T [ x [ n ]] ⟹ T [ x [ n − n 0 ]] = y [ n − n 0 ] Causale : rispetta il nesso causa-effetto . L’output si ottiene considerando l’input solamente negli istanti di tempo passati.

y [ n ] = T [ x [ α ] , α ≤ t ; t ] y[n] = \mathcal{T} [x[\alpha], \, \alpha \leq t ; \,t] y [ n ] = T [ x [ α ] , α ≤ t ; t ] Istantaneo o senza memoria : l’output ad un dato istante si ottiene considerando l’input solamente nel medesimo istante.

y [ n ] = T [ x [ α ] , α = t ] y[n] = \mathcal{T} [x[\alpha], \, \alpha = t] y [ n ] = T [ x [ α ] , α = t ] Stabile : la limitatezza del dominio dell’input implica un dominio limitato anche per l’output.

∣ x [ n ] ∣ ≤ M ⟹ ∣ y [ n ] ∣ ≤ N , ∀ t |x[n]| \leq M \implies |y[n]|\leq N,\; \forall t ∣ x [ n ] ∣ ≤ M ⟹ ∣ y [ n ] ∣ ≤ N , ∀ t Invertibile : scambiando l’input con l’output continua ad esistere una trasformazione che leghi tali funzioni.

∃ T − 1 t.c. x [ n ] = T − 1 [ y [ n ] ] \exist \mathcal{T}^{-1} \; \text{ t.c. } \; x[n]=\mathcal{T}^{-1}[y[n]] ∃ T − 1 t.c. x [ n ] = T − 1 [ y [ n ]] Un sistema LTI (lineare tempo-invariato ) o SLS (sistema lineare stazionario ) gode delle seguenti proprietà sopra citate:

Linearità: principio di sovrapposizione degli effetti

Stazionarietà: tempo-invarianza

L’istante iniziale di un sistema tempo-invariato si può sempre assumere nullo: t 0 = 0 t_0=0 t 0 = 0

Un sistema LTI monodimensionale tempo-continuo è descritto da risposta impulsiva h ( t ) h(t) h ( t ) H ( f ) H(f) H ( f )

multi-variabile o MIMO : Multi-Input Multi-Output

singola variabile o SISO : Single-Input Single-Output

I paragrafi che seguono trattano dunque sistemi LTI SISO .

I sistemi LTI possono essere sia tempo-continui che tempo discreti.

→ δ ( t ) T → h ( t ) \Large \xrightarrow{\delta(t)} \boxed{\mathcal{T}} \xrightarrow{h(t)} δ ( t ) T h ( t ) La risposta impulsiva per sistemi tempo-continui è la risposta all’impulso Delta di Dirac: h ( t ) = T [ δ ( t ) ] h(t) = \mathcal{T}[\delta(t)] h ( t ) = T [ δ ( t )] h ( t ) h(t) h ( t )

y ( t ) = T [ x ( t ) ] = ∫ − ∞ ∞ x ( τ ) T [ δ ( t − τ ) ] d τ = ∫ − ∞ ∞ x ( t ) h ( t − τ ) d τ = x ( t ) ⊗ h ( t ) y(t)=\mathcal{T}[x(t)]=\int_{-\infty}^{\infty} x(\tau) \mathcal{T} [\delta(t-\tau)]d\tau = \int_{-\infty}^{\infty} x(t)h(t-\tau)d\tau = x(t) \otimes h(t) y ( t ) = T [ x ( t )] = ∫ − ∞ ∞ x ( τ ) T [ δ ( t − τ )] d τ = ∫ − ∞ ∞ x ( t ) h ( t − τ ) d τ = x ( t ) ⊗ h ( t ) Il sistema è lineare, l’integrale rappresenta una somma.

Il sistema è causale ⟺ h ( t ) = 0 \iff h(t) = 0 ⟺ h ( t ) = 0 t < 0 t<0 t < 0 ⟺ ∫ − ∞ ∞ ∣ h ( t ) ∣ ≤ M \iff \int_{-\infty}^{\infty} |h(t)| \leq M ⟺ ∫ − ∞ ∞ ∣ h ( t ) ∣ ≤ M

Nel campo dei sistemi tempo-discreti, la funzione Delta di Dirac non esiste: viene approssimata dall’impulso unitario δ [ n ] \delta [n] δ [ n ]

→ δ [ n ] T → y [ n ] \Large \xrightarrow{\delta[n]} \boxed{\mathcal{T}} \xrightarrow{y[n]} δ [ n ] T y [ n ] La risposta impulsiva è utile per determinare l’output quando è noto l’input. Si applica l’operatore di convoluzione.

y [ n ] = T [ δ [ n ] ] ⟹ x [ n ] = x [ n ] ∗ δ [ n ] \large y[n] = \mathcal{T} \bigg[\delta [n]\bigg] \implies x[n]=x[n]\ast\delta [n] y [ n ] = T [ δ [ n ] ] ⟹ x [ n ] = x [ n ] ∗ δ [ n ] Si può dimostrare che:

y [ n ] = T L T I [ x [ n ] ] = ∑ m = − ∞ ∞ x [ k ] h [ n − k ] y[n]=\mathcal{T}_{\rm LTI} \biggl[ x[n]\biggr]=\sum_{m=-\infty}^\infty x[k]h[n-k] y [ n ] = T LTI [ x [ n ] ] = m = − ∞ ∑ ∞ x [ k ] h [ n − k ] Il sistema è causale ⟺ h [ n ] = 0 \iff h[n]=0 ⟺ h [ n ] = 0 n < 0 n<0 n < 0 ⟺ ∑ n = − ∞ + ∞ ∣ h [ n ] ∣ = M < ∞ \iff \sum_{n=-\infty}^{+\infty} |h[n]|=M <\infty ⟺ ∑ n = − ∞ + ∞ ∣ h [ n ] ∣ = M < ∞

H ( f ) = F [ h ( t ) ] \Large H(f) = \mathcal{F}[h(t)] H ( f ) = F [ h ( t )] La risposta in frequenza è la trasformata di Fourier della risposta impulsiva.

y ( t ) = x ( t ) ∗ h ( t ) ⟹ Y ( f ) = X ( f ) ⋅ H ( f ) ⟹ H ( f ) = Y ( f ) X ( f ) y(t)=x(t) \ast h(t) \implies Y(f)=X(f)\cdot H(f) \implies H(f)=\frac{Y(f)}{X(f)} y ( t ) = x ( t ) ∗ h ( t ) ⟹ Y ( f ) = X ( f ) ⋅ H ( f ) ⟹ H ( f ) = X ( f ) Y ( f ) Il dominio di esistenza della risposta in frequenza è l’insieme dei numeri complessi C \C C

risposta in ampiezza: A ( f ) = ∣ H ( f ) ∣ A(f) = |H(f)| A ( f ) = ∣ H ( f ) ∣

risposta in fase: Θ ( f ) = arg ( H ( f ) ) \Theta(f) = \arg(H(f)) Θ ( f ) = arg ( H ( f ))

H ( f ) = A ( f ) e j Θ ( f ) ∈ C H(f)=A(f)e^{j\Theta(f)} \in \C H ( f ) = A ( f ) e j Θ ( f ) ∈ C La risposta in frequenza è la trasformata di Fourier della risposta impulsiva anche per i sistemi tempo-discreti. La risposta in frequenza dei sistemi tempo-discreto hanno periodo 1 / T 1/T 1/ T

H ‾ ( f ) = F [ h [ n ] ] = ∑ n = − ∞ ∞ h [ n ] e − j 2 π f n T = Y ‾ ( f ) X ‾ ( f ) \large \overline{H}(f) =\mathcal{F}[h[n]]=\sum_{n=-\infty}^\infty h[n]e^{-j2\pi fnT}=\frac{\overline{Y}(f)}{\overline{X}(f)} H ( f ) = F [ h [ n ]] = n = − ∞ ∑ ∞ h [ n ] e − j 2 π f n T = X ( f ) Y ( f ) Questo paragrafo analizza segnali tempo-continui, ma i ragionamenti fatti potrebbero essere riportati per segnali tempo-discreti.

→ x ( t ) T 1 → y ( t ) T 2 → z ( t ) \Large

\xrightarrow{x(t)}

\boxed{\mathcal{T}_1}

\xrightarrow{y(t)}

\boxed{\mathcal{T}_2}

\xrightarrow{z(t)} x ( t ) T 1 y ( t ) T 2 z ( t ) Dunque la funzione in output è:

z ( t ) = y ( t ) ∗ h 2 ( t ) = [ x ( t ) ∗ h 1 ( t ) ] ∗ h 2 ( t ) z(t)=y(t)\ast h_2(t)=\bigg[ x(t)\ast h_1(t) \bigg]\ast h_2(t) z ( t ) = y ( t ) ∗ h 2 ( t ) = [ x ( t ) ∗ h 1 ( t ) ] ∗ h 2 ( t ) Concettualmente equivalente ai due schemi a blocchi che seguono:

→ x ( t ) h 1 ( t ) ∗ h 2 ( t ) → z ( t ) ; → X ( f ) H 1 ( f ) H 2 ( f ) → Z ( f ) \xrightarrow{x(t)}

\boxed{h_1(t)\ast h_2(t)}

\xrightarrow{z(t)}

\quad ; \quad

\xrightarrow{X(f)}

\boxed{H_1(f)H_2(f)}

\xrightarrow{Z(f)} x ( t ) h 1 ( t ) ∗ h 2 ( t ) z ( t ) ; X ( f ) H 1 ( f ) H 2 ( f ) Z ( f ) La cascata è invertibile. Con y ~ ( t ) ≠ y ( t ) \widetilde{y}(t) \neq y(t) y ( t ) = y ( t )

→ x ( t ) T 2 → y ~ ( t ) T 1 → z ( t ) \Large

\xrightarrow{x(t)}

\boxed{\mathcal{T}_2}

\xrightarrow{\widetilde{y}(t)}

\boxed{\mathcal{T}_1}

\xrightarrow{z(t)} x ( t ) T 2 y ( t ) T 1 z ( t ) Si consideri un sistema lineare e stazionario. Sia x ( t ) x(t) x ( t ) y ( t ) y(t) y ( t )

Il sistema è composto da un nodo sommatore:

z ( t ) = x ( t ) + y ( t ) z(t) = x(t)+y(t) z ( t ) = x ( t ) + y ( t ) In seguito, sono disposti due dispositivi in cascata che eseguono le trasformazioni:

w ( t ) = 1 2 π A d z ( t ) d t y ( t ) = 1 2 π A d w ( t ) d t \begin{aligned}

w(t) &= \frac{1}{2\pi A} \frac{dz(t)}{dt}\\ \\

y(t) &= \frac{1}{2\pi A} \frac{dw(t)}{dt}

\end{aligned} w ( t ) y ( t ) = 2 π A 1 d t d z ( t ) = 2 π A 1 d t d w ( t ) con A = 2 ⋅ 10 4 A=2 \cdot 10^4 A = 2 ⋅ 1 0 4 kHz e il segnale y ( t ) y(t) y ( t )

Si può formalizzare quanto scritto sopra con un paio di sistemi di equazioni:

{ z ( t ) = x ( t ) + y ( t ) w ( t ) = 1 2 π A d z ( t ) d t y ( t ) = 1 2 π A d w ( t ) d t → F { Z ( f ) = X ( f ) + Y ( f ) W ( f ) = 1 2 π A Z ( f ) j 2 π f = j f A Z ( f ) Y ( f ) = 1 2 π A W ( f ) j 2 π f = j f A W ( f ) \begin{cases}

z(t) = x(t) + y(t)\\

w(t) = \frac{1}{2\pi A} \frac{dz(t)}{dt}\\

y(t) = \frac{1}{2\pi A} \frac{d w(t)}{dt}\\

\end{cases}

\Large

\xrightarrow{\mathcal{F}}

\normalsize

\begin{cases}

Z(f) = X(f) + Y(f)\\

W(f) = \frac{1}{2\pi A} Z(f) j2\pi f = \frac{jf}{A} Z(f)\\

Y(f) = \frac{1}{2\pi A} W(f) j2\pi f = \frac{jf}{A} W(f)\\

\end{cases} ⎩ ⎨ ⎧ z ( t ) = x ( t ) + y ( t ) w ( t ) = 2 π A 1 d t d z ( t ) y ( t ) = 2 π A 1 d t d w ( t ) F ⎩ ⎨ ⎧ Z ( f ) = X ( f ) + Y ( f ) W ( f ) = 2 π A 1 Z ( f ) j 2 π f = A j f Z ( f ) Y ( f ) = 2 π A 1 W ( f ) j 2 π f = A j f W ( f ) Si può ottenere così la definizione di Y ( f ) = F [ y ( t ) ] Y(f) = \mathcal{F}[y(t)] Y ( f ) = F [ y ( t )]

Y ( f ) = j f A W ( f ) = j f A ( j f A Z ( f ) ) = = j 2 ⋅ f 2 A 2 ( X ( f ) + Y ( f ) ) ⟹ Y ( f ) [ 1 + f 2 A 2 ] = − f 2 A 2 X ( f ) ⟹ Y ( f ) = − f 2 X ( f ) A 2 + f 2 \begin{aligned}

Y(f) &= \frac{jf}{A} W(f) = \frac{jf}{A} \bigg(\frac{jf}{A} Z(f)\bigg) =\\

&= \frac{j^2 \cdot f^2}{A^2} \bigg(X(f) + Y(f)\bigg)\\

\implies & Y(f)\bigg[ 1+ \frac{f^2}{A^2}\bigg] = -\frac{f^2}{A^2}X(f) \\

\implies & Y(f) = \frac{-f^2 X(f)}{A^2 + f^2}

\end{aligned} Y ( f ) ⟹ ⟹ = A j f W ( f ) = A j f ( A j f Z ( f ) ) = = A 2 j 2 ⋅ f 2 ( X ( f ) + Y ( f ) ) Y ( f ) [ 1 + A 2 f 2 ] = − A 2 f 2 X ( f ) Y ( f ) = A 2 + f 2 − f 2 X ( f ) Parte 1 : Determinare risposta in ampiezza e in fase del sistema.

La risposta in frequenza è:

H ( f ) = Y ( f ) X ( f ) = − f 2 A 2 + f 2 H(f) = \frac{Y(f)}{X(f)} = \frac{-f^2}{A^2 + f^2} H ( f ) = X ( f ) Y ( f ) = A 2 + f 2 − f 2 La risposta in ampiezza è il suo modulo:

∣ H ( f ) ∣ = f 2 A 2 + f 2 |H(f)| = \frac{f^2}{A^2 + f^2} ∣ H ( f ) ∣ = A 2 + f 2 f 2 La risposta in fase è:

arg ( H ( f ) ) = arg ( − f 2 ) − arg ( A 2 + f 2 ) = 0 \arg\Big(H(f)\Big) = \arg\Big(-f^2\Big)-\arg\Big(A^2 + f^2\Big) = 0 arg ( H ( f ) ) = arg ( − f 2 ) − arg ( A 2 + f 2 ) = 0 Parte 2 : Determinare il tipo di filtro realizzato e la banda B (usando i limiti di banda a -3dB).

Bisogna trovare la frequenza f 0 ∈ R f_0 \in \R f 0 ∈ R ∣ H ( f ) ∣ |H(f)| ∣ H ( f ) ∣

∣ H ( f ) ∣ → f ⟶ 0 0 ∣ H ( f ) ∣ → f ⟶ ∞ 1 ⟹ max ∣ H ( f 0 ) ∣ = 1 f 0 = ∞ \begin{aligned}

& |H(f)| \xrightarrow{\; f \longrightarrow 0 \;} 0 \\

& |H(f)| \xrightarrow{\; f \longrightarrow \infty \;} 1 \\

\implies & \max |H(f_0)| = 1 \quad f_0 = \infty

\end{aligned} ⟹ ∣ H ( f ) ∣ f ⟶ 0 0 ∣ H ( f ) ∣ f ⟶ ∞ 1 max ∣ H ( f 0 ) ∣ = 1 f 0 = ∞ Il filtro in esame è un passa-alto.

La banda a -3dB si ottiene grazie alla relazione:

∣ X ( f − 3 ) ∣ ∣ X ( f 0 ) ∣ = 1 2 \frac{|X(f_{-3})|}{|X(f_0)|} = \frac{1}{\sqrt{2}} ∣ X ( f 0 ) ∣ ∣ X ( f − 3 ) ∣ = 2 1 Si può notare che f − 3 f_{-3} f − 3 f 2 f^2 f 2 B − 3 B_{-3} B − 3

∣ X ( f − 3 ) ∣ = ∣ X ( f 0 ) ∣ 2 f − 3 2 A 2 + f − 3 2 = 1 2 2 ⋅ f − 3 2 = A 2 + f − 3 2 f − 3 2 ( 2 − 1 ) = A 2 ⟹ f − 3 = ± A 2 2 − 1 ⟹ B − 3 = ± A 2 2 − 1 \begin{aligned}

& |X(f_{-3})| = \frac{|X(f_0)|}{\sqrt{2}} \\

& \frac{f_{-3}^2}{A^2 + f_{-3}^2} = \frac{1}{\sqrt{2}} \\

& \sqrt{2}\cdot f_{-3}^2 = A^2 + f_{-3}^2 \\

& f_{-3}^2 \Big(\sqrt{2} - 1 \Big) = A^2 \\

\implies & f_{-3} = \pm \sqrt{\frac{A^2}{\sqrt{2}-1}} \\

\implies & B_{-3} = \pm \sqrt{\frac{A^2}{\sqrt{2}-1}} \\

\end{aligned} ⟹ ⟹ ∣ X ( f − 3 ) ∣ = 2 ∣ X ( f 0 ) ∣ A 2 + f − 3 2 f − 3 2 = 2 1 2 ⋅ f − 3 2 = A 2 + f − 3 2 f − 3 2 ( 2 − 1 ) = A 2 f − 3 = ± 2 − 1 A 2 B − 3 = ± 2 − 1 A 2 Parte 3 : Determinare segnale di uscita quando l’ingresso è x ( t ) = β cos ( 2 π A t ) x(t) = \beta\cos(2\pi At) x ( t ) = β cos ( 2 π A t ) β = 4 \beta = 4 β = 4

Per completezza, si calcola anche la trasformata di Fourier di ingresso ed uscita.

La proprietà della modulazione afferma:

F [ x ~ ( t ) cos ( 2 π f 0 t ) ] = 1 2 [ X ~ ( f − f 0 ) + X ~ ( f + f 0 ) ] \mathcal{F} \bigg[ \widetilde{x}(t)\cos(2\pi f_0 t) \bigg] =

\frac{1}{2}\bigg[\widetilde{X}(f-f_0)+\widetilde{X}(f+f_0)\bigg] F [ x ( t ) cos ( 2 π f 0 t ) ] = 2 1 [ X ( f − f 0 ) + X ( f + f 0 ) ] Sapendo che la trasformata di una costante è la delta di dirac moltiplicata per la medesima costante, allora:

x ~ ( t ) = β ⟹ X ~ ( f ) = β ⋅ δ ( f ) f 0 = A = 2 ⋅ 10 4 [Hz] ⟹ X ( f ) = β 2 [ δ ( f − A ) + δ ( f + A ) ] \begin{aligned}

& \widetilde{x}(t) = \beta\implies\widetilde{X}(f) =\beta\cdot\delta(f) \\

& f_0 = A = 2 \cdot 10^4 \; \text{[Hz]} \\

\implies & X(f) = \frac{\beta}{2}\bigg[\delta(f-A)+\delta(f+A)\bigg]

\end{aligned} ⟹ x ( t ) = β ⟹ X ( f ) = β ⋅ δ ( f ) f 0 = A = 2 ⋅ 1 0 4 [Hz] X ( f ) = 2 β [ δ ( f − A ) + δ ( f + A ) ] Il segnale in uscita è nella forma:

y ( t ) = ∣ H ( f 0 ) ∣ ⋅ β cos [ 2 π f 0 t + arg ( H ( A ) ) ] = = ∣ H ( A ) ∣ ⋅ 4 cos [ 2 π A t + arg ( H ( A ) ) ] \begin{aligned}

y(t) &= |H(f_0)| \cdot\beta\cos\Big[2\pi f_0 t + \arg\big(H(A)\big)\Big]=\\

&= |H(A)| \cdot 4 \cos\Big[2\pi A t + \arg\big(H(A)\big)\Big]\\

\end{aligned} y ( t ) = ∣ H ( f 0 ) ∣ ⋅ β cos [ 2 π f 0 t + arg ( H ( A ) ) ] = = ∣ H ( A ) ∣ ⋅ 4 cos [ 2 π A t + arg ( H ( A ) ) ] Si può procedere con i calcoli:

∣ H ( A ) ∣ = A 2 A 2 + A 2 = 1 2 arg ( H ( A ) ) = arg ( − 1 2 ) = = tan − 1 ( 0 − 1 / 2 ) + π = = π \begin{aligned}

|H(A)| &= \frac{A^2}{A^2 + A^2} = \frac{1}{2}\\\

\arg\big(H(A)\big)&= \arg\Big(-\frac{1}{2}\Big) =\\

&= \tan^{-1}\Big(\frac{0}{-1/2}\Big) + \pi=\\

&= \pi

\end{aligned} ∣ H ( A ) ∣ arg ( H ( A ) ) = A 2 + A 2 A 2 = 2 1 = arg ( − 2 1 ) = = tan − 1 ( − 1/2 0 ) + π = = π con ℑ [ − 1 / 2 ] = 0 \Im[-1/2]=0 ℑ [ − 1/2 ] = 0

Dunque l’output del sistema risulta essere:

y ( t ) = ∣ H ( A ) ∣ ⋅ β cos [ 2 π A t + arg ( H ( A ) ) ] = = 1 2 ⋅ 4 cos ( 2 π A t + π ) = = 2 cos ( 2 π A t + π ) \begin{aligned}

y(t) &= |H(A)| \cdot \beta \cos\Big[2\pi A t + \arg\big(H(A)\big)\Big]=\\

&= \frac{1}{2} \cdot 4 \cos\Big(2\pi A t + \pi\Big)=\\

&= 2 \cos\Big(2\pi A t + \pi\Big)\\

\end{aligned} y ( t ) = ∣ H ( A ) ∣ ⋅ β cos [ 2 π A t + arg ( H ( A ) ) ] = = 2 1 ⋅ 4 cos ( 2 π A t + π ) = = 2 cos ( 2 π A t + π ) La distorsione di segnali elaborati da un sistema è una trasformazione che lega una funzione di input x ( t ) x(t) x ( t ) y ( t ) y(t) y ( t )

→ (INPUT) x ( t ) T → (OUTPUT) y ( t ) \Large \xrightarrow[\text{ (INPUT) }]{x(t)}

\boxed{\mathcal{T}}

\xrightarrow[\text{ (OUTPUT) }]{y(t)} x ( t ) (INPUT) T y ( t ) (OUTPUT) Le operazioni tollerate per la condizione di non distorsione sono:

la traslazione nel tempo,

la moltiplicazione per una costante.

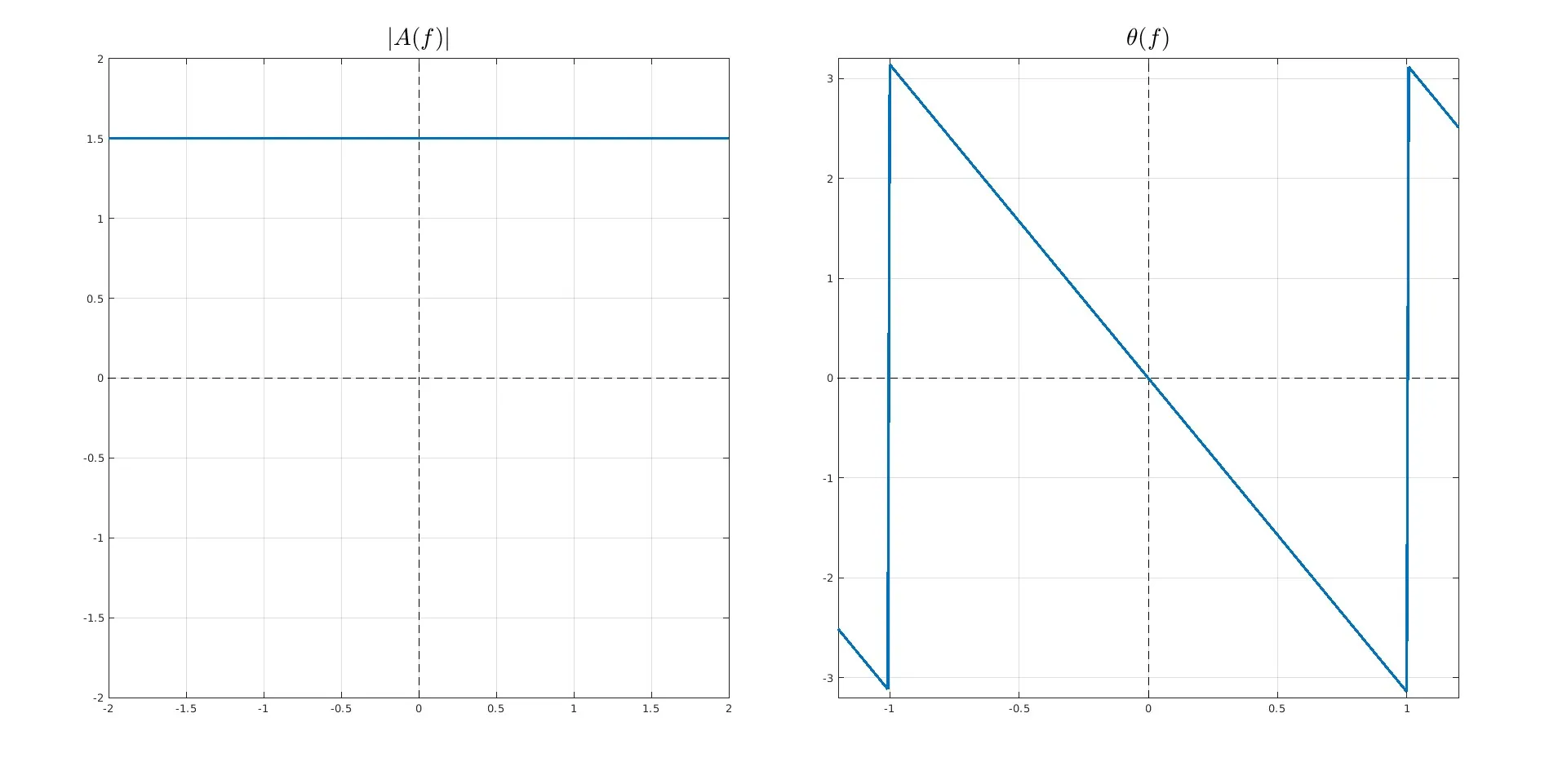

y ( t ) y(t) y ( t ) x ( t ) x(t) x ( t )

y ( t ) = k ⋅ x ( t − t 0 ) , ∀ k , t 0 ∈ R ; k ≠ 0 y(t)=k\cdot x(t-t_0),\quad \forall k, t_0\in \R;\,k\neq 0 y ( t ) = k ⋅ x ( t − t 0 ) , ∀ k , t 0 ∈ R ; k = 0 Nel campo dei sistemi LTI, la condizione di non distorsione nel dominio delle frequenze è:

H ( f ) = k e − j 2 π f t 0 ∀ f ∈ B x = { f : X ( f ) ≠ 0 } ⟹ { A ( f ) = ∣ k ∣ Θ ( f ) = − 2 π f t 0 \begin{aligned}

H(f)&=ke^{-j2\pi ft_0} \quad \forall f \in B_x=\{f:X(f)\neq 0\} \\

& \implies

\begin{cases}

A(f) = |k|\\

\Theta(f) = -2\pi f t_0

\end{cases}

\end{aligned} H ( f ) = k e − j 2 π f t 0 ∀ f ∈ B x = { f : X ( f ) = 0 } ⟹ { A ( f ) = ∣ k ∣ Θ ( f ) = − 2 π f t 0 Dati k = 1.5 k=1.5 k = 1.5 t 0 = 0.5 t_0=0.5 t 0 = 0.5 B x B_x B x B x = [ − 1 1 ] B_x = [-1\;1] B x = [ − 1 1 ]

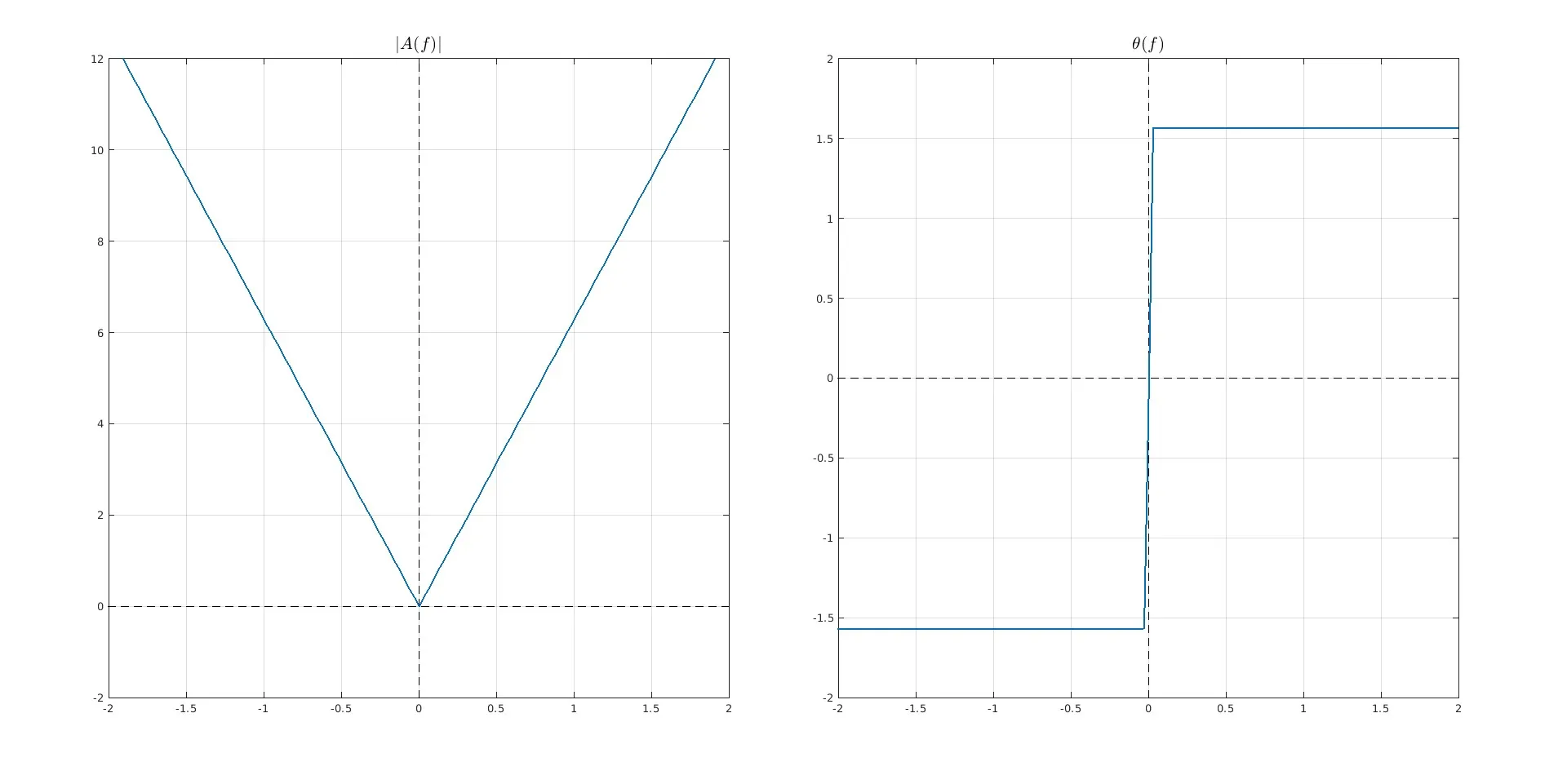

Esempio : data la trasformazione T = d / d t \mathcal{T} = d/dt T = d / d t

→ x ( t ) d d t → y ( t ) y ( t ) = d d t x ( t ) → F Y ( f ) = X ( f ) ⋅ j 2 π f \begin{aligned}

\Large \xrightarrow{x(t)}

\boxed{\frac{d}{dt}}

\xrightarrow{y(t)}\\

y(t)=\frac{d}{dt}x(t) \xrightarrow{\mathcal{F}}Y(f)=X(f)\cdot j2\pi f

\end{aligned} x ( t ) d t d y ( t ) y ( t ) = d t d x ( t ) F Y ( f ) = X ( f ) ⋅ j 2 π f La risposta in frequenza è:

H ( f ) = j 2 π f ⟹ { A ( f ) = 2 π ∣ f ∣ Θ ( f ) = { π / 2 f > 0 − π / 2 f < 0 \begin{aligned}

& H(f)=j2\pi f\\

& \implies

\begin{cases}

A(f)=2\pi |f|\\ \Theta(f)=

\begin{cases}\pi/2 \quad &f>0\\ -\pi/2 \quad &f<0

\end{cases}

\end{cases}

\end{aligned} H ( f ) = j 2 π f ⟹ ⎩ ⎨ ⎧ A ( f ) = 2 π ∣ f ∣ Θ ( f ) = { π /2 − π /2 f > 0 f < 0

I grafici si ottengono con il seguente codice MATLAB:

f_lim= 15 ; f=linspace(-f_lim, f_lim, 1001 ); zero_values=zeros(length(f));

H_f= 1j * 2 * pi .*f; % frequency response

A_f=abs(H_f); % amplitude of H(f)

Theta_f=angle(H_f); % argument of H(f)

tiledlayout( 1 , 2 ); nexttile

plot(zero_values,f, ' -- ' ,f, zero_values, ' -- ' ,Color= " black " )

hold on; plot(f,A_f,LineWidth=1.5)

grid on; xlim([-2 2]); ylim([-2 12])

title({ ' $|A(f)|$ ' }, ' Interpreter ' , ' latex ' , ' FontSize ' , 16 )

plot(zero_values,f, ' -- ' ,f,zero_values, ' -- ' ,Color= " black " )

hold on; plot(f,Theta_f, LineWidth=1.5)

grid on; xlim([-2 2]); ylim([-2 2])

title({ ' $\Theta(f)$ ' }, ' Interpreter ' , ' latex ' , ' FontSize ' , 16 )

Per la maggior parte dei segnali, il sistema che applica la derivazione è distorcente .

→ (INPUT) x ( t ) g [ ⋅ ] → (OUTPUT) y ( t ) \Large \xrightarrow[\text{ (INPUT) }]{x(t)}

\boxed{g[\cdot]}

\xrightarrow[\text{ (OUTPUT) }]{y(t)} x ( t ) (INPUT) g [ ⋅ ] y ( t ) (OUTPUT) I sistemi non lineari sono stazionari ed istantanei. L’output è nella forma:

y ( t ) = g [ x ( t ) ] y(t)=g[x(t)] y ( t ) = g [ x ( t )] con g ( x ) g(x) g ( x )

Il sistema è non lineare : non vale il principio di sovrapposizione degli effetti.

g ( t ) = α x 1 ( t ) + β x 2 ( t ) \centernot ⟹ y ( t ) = α g [ x 1 ( t ) ] + β g [ x 2 ( t ) ] g(t)=\alpha x_1(t) + \beta x_2(t) \centernot\implies y(t)=\alpha g[x_1(t)] +\beta g[x_2(t)] g ( t ) = α x 1 ( t ) + β x 2 ( t ) \centernot ⟹ y ( t ) = α g [ x 1 ( t )] + β g [ x 2 ( t )] Il sistema è stazionario :

y ( t ) = g [ x ( t ) ] ⟹ g [ x ( t − t 0 ) ] = y ( t − t 0 ) y(t) = g[x(t)] \implies g[x(t-t_0)] = y(t-t_0) y ( t ) = g [ x ( t )] ⟹ g [ x ( t − t 0 )] = y ( t − t 0 ) Il sistema è istantaneo o senza memoria :

y ( t ) = g [ x ( α ) , α = t ] y(t) = g[x(\alpha), \, \alpha = t] y ( t ) = g [ x ( α ) , α = t ] Dato l’input di riferimento x ( t ) = a cos ( 2 π f 0 t ) x(t)=a \cos(2\pi f_0 t) x ( t ) = a cos ( 2 π f 0 t ) T 0 = 1 / f 0 T_0 = 1/f_0 T 0 = 1/ f 0

L’output è y ( t ) = g [ a cos ( 2 π f 0 t ) ] y(t)=g[a\cos(2\pi f_0 t)] y ( t ) = g [ a cos ( 2 π f 0 t )]

Y k = 1 T 0 ∫ − T 0 / 2 T 0 / 2 g [ x ( t ) ] e − j 2 π k t / T 0 d t ∀ k \large Y_k = \frac{1}{T_0} \int_{-T_0/2}^{T_0/2} g[x(t)]e^{-j2\pi k t/T_0}dt \quad \forall k Y k = T 0 1 ∫ − T 0 /2 T 0 /2 g [ x ( t )] e − j 2 π k t / T 0 d t ∀ k Ad ogni coppia di coefficienti ± k \pm k ± k

2 ∣ Y k ∣ cos ( 2 π k f 0 t + arg ( Y k ) ) 2|Y_k|\cos(2\pi k f_0 t + \arg(Y_k)) 2∣ Y k ∣ cos ( 2 π k f 0 t + arg ( Y k )) In 0 0 0 2 f 0 , 3 f 0 , … 2f_0,\;3f_0,\;\dots 2 f 0 , 3 f 0 , …

Il coefficiente di distorsione armonica di ordine k k k

D k = P k P 1 = ( 2 ∣ Y k ∣ ) 2 / 2 ( 2 ∣ Y 1 ∣ ) 2 / 2 = ∣ Y k ∣ ∣ Y 1 ∣ D_k = \sqrt{\frac{P_k}{P_1}}= \sqrt{\frac{(2|Y_k|)^2/2}{(2|Y_1|)^2/2}}=\frac{|Y_k|}{|Y_1|} D k = P 1 P k = ( 2∣ Y 1 ∣ ) 2 /2 ( 2∣ Y k ∣ ) 2 /2 = ∣ Y 1 ∣ ∣ Y k ∣ La total harmonic distortion è definita come:

THD = ∑ k = 2 ∞ P k P 1 = ∑ k = 2 ∞ ∣ Y k ∣ 2 ∣ Y 1 ∣ 2 = ∑ k = 1 ∞ D k 2 = P k − P 0 − P 1 P 1 = P k − Y 0 1 2 ∣ Y 1 ∣ 2 − 1 \text{THD}

= \sqrt{\frac{\sum_{k=2}^\infty P_k}{P_1}}

= \sqrt{\sum_{k=2}^\infty\frac{|Y_k|^2}{|Y_1|^2}}

= \sqrt{\sum_{k=1}^\infty D_k^2}

= \sqrt{\frac{P_k-P_0-P_1}{P_1}}

= \sqrt{\frac{P_k-Y_0^1}{2|Y_1|^2}-1} THD = P 1 ∑ k = 2 ∞ P k = k = 2 ∑ ∞ ∣ Y 1 ∣ 2 ∣ Y k ∣ 2 = k = 1 ∑ ∞ D k 2 = P 1 P k − P 0 − P 1 = 2∣ Y 1 ∣ 2 P k − Y 0 1 − 1 Si noti che:

P Y = P 0 + P 1 + ∑ k = 2 ∞ P k ⟹ ∑ k = 2 ∞ P k = P Y − P 0 − P 1 P_Y = P_0 + P_1 + \sum_{k=2}^\infty P_k

\implies \sum_{k=2}^\infty P_k = P_Y-P_0-P_1 P Y = P 0 + P 1 + k = 2 ∑ ∞ P k ⟹ k = 2 ∑ ∞ P k = P Y − P 0 − P 1 Si consideri un sistema non lineare con ingresso x ( t ) x(t) x ( t ) y ( t ) y(t) y ( t )

y = g ( x ) = A u ( x ) y = g(x) = Au(x) y = g ( x ) = A u ( x ) dove u ( ⋅ ) u(\cdot) u ( ⋅ ) A = 8 A = 8 A = 8

Si richiede di effettuare il grafico del segnale in uscita quando l’input è:

x ( t ) = cos ( 2 π t / T 0 ) x(t) = \cos(2\pi t / T_0) x ( t ) = cos ( 2 π t / T 0 ) e di determinare lo spettro di ampiezza di y ( t ) y(t) y ( t )

Il gradino unitario annulla la funzione per x ( t ) < 0 x(t)<0 x ( t ) < 0

Parte 1 : Definire formalmente il segnale di uscita.

Bisogna determinare per quali valori di t t t x ( t ) > 0 x(t)>0 x ( t ) > 0

Per la sola circonferenza goniometrica, ovvero per il dominio [ − 1 , 1 ] [-1,1] [ − 1 , 1 ]

cos ( α ) > 0 ∀ − π / 2 < α < π / 2 ⟹ x ( t ) > 0 ⟹ cos ( 2 π t / T 0 ) > 0 ⟹ − π 2 < 2 π T 0 t < π 2 ⟹ − π 2 T 0 2 π < t < π 2 T 0 2 π ⟹ − T 0 4 < t < T 0 4 \begin{aligned}

& \cos(\alpha)>0\quad\forall -\pi/2 <\alpha <\pi/2 \\

& \implies x(t)>0\implies \cos(2\pi t/T_0)>0 \\

& \implies -\frac{\pi}{2}<\frac{2\pi}{T_0}t<\frac{\pi}{2}\\

& \implies -\frac{\pi}{2}\frac{T_0}{2\pi}<t<\frac{\pi}{2}\frac{T_0}{2\pi}\\

& \implies -\frac{T_0}{4}<t<\frac{T_0}{4}

\end{aligned} cos ( α ) > 0 ∀ − π /2 < α < π /2 ⟹ x ( t ) > 0 ⟹ cos ( 2 π t / T 0 ) > 0 ⟹ − 2 π < T 0 2 π t < 2 π ⟹ − 2 π 2 π T 0 < t < 2 π 2 π T 0 ⟹ − 4 T 0 < t < 4 T 0 Dato k ∈ Z k\in\Z k ∈ Z t t t R \R R

y ( t ) = g ( x ( t ) ) = A u ( x ( t ) ) = = { A x ( t ) > 0 0 x ( t ) < 0 = { A − T 0 / 4 + 2 π k < t < T 0 / 4 + 2 π k 0 t < − T 0 / 4 + 2 π k ∧ t > T 0 / 4 + 2 π k = { A ∣ t ∣ < T 0 / 4 + 2 π k 0 ∣ t ∣ > T 0 / 4 + 2 π k = ∑ k = − ∞ + ∞ A rect ( t − k T 0 T 0 / 2 ) \begin{aligned}

y(t) &= g\big(x(t)\big) = Au\big(x(t)\big) =\\

&= \begin{cases}

A \quad & x(t) > 0\\

0 \quad & x(t) < 0

\end{cases}\\

&= \begin{cases}

A \quad & -T_0/4+2\pi k < t < T_0/4+2\pi k\\

0 \quad & t < -T_0/4+2\pi k \land t > T_0/4+2\pi k

\end{cases}\\

&= \begin{cases}

A \quad & |t| < T_0/4+2\pi k\\

0 \quad & |t| > T_0/4+2\pi k\\

\end{cases}\\

&= \sum_{k=-\infty}^{+\infty} A \;\text{rect} \bigg(\frac{t-k T_0}{T_0/2} \bigg)

\end{aligned} y ( t ) = g ( x ( t ) ) = A u ( x ( t ) ) = = { A 0 x ( t ) > 0 x ( t ) < 0 = { A 0 − T 0 /4 + 2 π k < t < T 0 /4 + 2 π k t < − T 0 /4 + 2 π k ∧ t > T 0 /4 + 2 π k = { A 0 ∣ t ∣ < T 0 /4 + 2 π k ∣ t ∣ > T 0 /4 + 2 π k = k = − ∞ ∑ + ∞ A rect ( T 0 /2 t − k T 0 ) Dunque l’output è un segnale continuo e periodico costituito da rettangoli alti A e lunghi T 0 / 2 T_0/2 T 0 /2

Dalla definizione soprastante si ha che:

− T 0 / 4 < t < T 0 / 4 ⟹ ∣ t ∣ < T 0 / 4 -T_0/4 < t < T_0/4 \implies |t| < T_0/4 − T 0 /4 < t < T 0 /4 ⟹ ∣ t ∣ < T 0 /4 Per poter scrivere un dominio di t più comprensibile, si calcola il rettangolo nel caso in cui k = 0 k=0 k = 0

rect ( t ) = { 0 ∣ t ∣ > 1 / 2 1 ∣ t ∣ < 1 / 2 1 / 2 ∣ t ∣ = 1 / 2 ≈ { 0 ∣ t ∣ ≥ 1 / 2 1 ∣ t ∣ < 1 / 2 rect ( t T 0 / 2 ) = { 0 ∣ t / ( T 0 / 2 ) ∣ ≥ 1 / 2 1 ∣ t / ( T 0 / 2 ) ∣ < 1 / 2 ⟹ ∣ t T 0 / 2 ∣ < 1 2 ⟹ 2 T 0 ∣ t ∣ < 1 2 ⟹ T 0 2 2 T 0 ∣ t ∣ < 1 2 T 0 2 ⟹ ∣ t ∣ < T 0 / 4 \begin{aligned}

& \text{rect}(t) = \begin{cases}

0 & \quad |t| > 1/2 \\

1 & \quad |t| < 1/2 \\

1/2 & \quad |t| = 1/2

\end{cases} \approx \begin{cases}

0 & \quad |t| \geq 1/2 \\

1 & \quad |t| < 1/2

\end{cases}\\

& \text{rect}\bigg(\frac{t}{T_0/2} \bigg) = \begin{cases}

0 & \quad |t/(T_0/2)| \geq 1/2 \\

1 & \quad |t/(T_0/2)| < 1/2

\end{cases} \\ \\

\implies & \bigg|\frac{t}{T_0/2}\bigg| < \frac{1}{2}

\implies \frac{2}{T_0}|t| < \frac{1}{2}

\implies \frac{T_0}{2}\frac{2}{T_0}|t| < \frac{1}{2}\frac{T_0}{2} \\

\implies & |t| < T_0/4

\end{aligned} ⟹ ⟹ rect ( t ) = ⎩ ⎨ ⎧ 0 1 1/2 ∣ t ∣ > 1/2 ∣ t ∣ < 1/2 ∣ t ∣ = 1/2 ≈ { 0 1 ∣ t ∣ ≥ 1/2 ∣ t ∣ < 1/2 rect ( T 0 /2 t ) = { 0 1 ∣ t / ( T 0 /2 ) ∣ ≥ 1/2 ∣ t / ( T 0 /2 ) ∣ < 1/2 T 0 /2 t < 2 1 ⟹ T 0 2 ∣ t ∣ < 2 1 ⟹ 2 T 0 T 0 2 ∣ t ∣ < 2 1 2 T 0 ∣ t ∣ < T 0 /4 Per includere in y ( t ) y(t) y ( t ) rect ( t / ( T 0 / 2 ) ) \text{rect}\Big(t / (T_0/2)\Big) rect ( t / ( T 0 /2 ) ) k T 0 kT_0 k T 0 k ∈ Z k \in \Z k ∈ Z

Grazie alla teoria delle ripetizioni periodiche , si può scrivere:

y ~ ( t ) = A rect ( t T 0 / 2 ) y ( t ) = ∑ n = − ∞ ∞ y ~ ( t − n T 0 ) ⟹ Y k = 1 T 0 Y ~ ( k T 0 ) \begin{aligned}

\widetilde{y}(t) &= A \;\text{rect} \bigg(\frac{t}{T_0/2} \bigg)\\

y(t) &= \sum_{n=-\infty}^{\infty} \widetilde{y}(t-nT_0) \\

& \implies Y_k = \frac{1}{T_0} \widetilde{Y}\bigg(\frac{k}{T_0}\bigg) \\

\end{aligned} y ( t ) y ( t ) = A rect ( T 0 /2 t ) = n = − ∞ ∑ ∞ y ( t − n T 0 ) ⟹ Y k = T 0 1 Y ( T 0 k ) Poiché la trasformata di Fourier del rettangolo è il seno cardinale, i coefficienti della serie sono:

Y k = 1 T 0 Y ~ ( k T 0 ) = = 1 T 0 2 T 0 sinc ( T 0 2 k T 0 ) = = 2 sinc ( k 2 ) \begin{aligned}

Y_k &= \frac{1}{T_0} \widetilde{Y}\bigg(\frac{k}{T_0}\bigg)=\\

&= \frac{1}{T_0} 2 T_0 \text{sinc}\bigg(\frac{T_0}{2} \frac{k}{T_0}\bigg)=\\

&= 2 \,\text{sinc}\bigg(\frac{k}{2} \bigg)

\end{aligned} Y k = T 0 1 Y ( T 0 k ) = = T 0 1 2 T 0 sinc ( 2 T 0 T 0 k ) = = 2 sinc ( 2 k ) Per determinare lo spettro di ampiezza di y ( t ) y(t) y ( t ) k :

k = 0 ⟶ Y 0 = 2 sinc ( 0 ) = 2 k = 1 ⟶ Y 1 = 2 sinc ( 1 / 2 ) = 4 / π k = 2 ⟶ Y 2 = 2 sinc ( 1 ) = 0 k = 3 ⟶ Y 3 = − 4 3 π k = 4 ⟶ Y 4 = 0 \begin{aligned}

k=0 & \longrightarrow Y_0 =2\;\text{sinc}(0)=2\\

k=1 & \longrightarrow Y_1 =2\;\text{sinc}(1/2)=4 / \pi\\

k=2 & \longrightarrow Y_2 =2\;\text{sinc}(1) = 0 \\

k=3 & \longrightarrow Y_3 =-\frac{4}{3\pi}\\

k=4 & \longrightarrow Y_4 =0\\

\end{aligned} k = 0 k = 1 k = 2 k = 3 k = 4 ⟶ Y 0 = 2 sinc ( 0 ) = 2 ⟶ Y 1 = 2 sinc ( 1/2 ) = 4/ π ⟶ Y 2 = 2 sinc ( 1 ) = 0 ⟶ Y 3 = − 3 π 4 ⟶ Y 4 = 0 Sia Y k ∗ Y_k^* Y k ∗ Y k Y_k Y k y ( t ) ∈ R y(t) \in \R y ( t ) ∈ R Y − k = Y k ∗ Y_{-k}=Y_k^* Y − k = Y k ∗

il modulo (ampiezza) è simmetrico rispetto a k k k ∣ Y − k ∣ = ∣ Y k ∗ ∣ |Y_{-k}|=|Y_k^*| ∣ Y − k ∣ = ∣ Y k ∗ ∣

gli argomenti (fasi) sono asimmetrici rispetto a k k k arg ( Y − k ) = − arg ( Y k ) \arg(Y_{-k})=-\arg(Y_{k}) arg ( Y − k ) = − arg ( Y k )

Questo argomento è analizzato nello specifico in un articolo dedicato: sistemi LTI multivariabile .